Antonio Fumero

I+D. Todo se puede solucionar con una cerveza fría.

Lo que AI es lo que AI

Hoy por hoy, todo el que hace software, hace Inteligencia Artificial o Analítica de Datos, que viene siendo lo mismo… o no.

Inteligencia Artificial

La red de expertos de OECD.AI ha desarrollado un marco conceptual a modo de herramienta para los responsables de la formulación de políticas, los reguladores, los legisladores y otros para que puedan evaluar las oportunidades y los riesgos que presentan los diferentes tipos de sistemas de IA y para informar sus estrategias nacionales al respecto.

¿Te suena?

Siendo todavía un desideratum, cualquiera diría que ya nos encontramos en un escenario en el que podemos considerar la Inteligencia Artificial (IA) como algo ubicuo. Existen sistemas de IA de todo tipo, por todas partes… y ya empiezan a responder, de manera consistente, a objetivos sociales o de negocio, lo cual hace que las consideraciones éticas asociadas a las tecnologías subyacentes cobren cada vez más relevancia.

La red de expertos de OECD.AI ha desarrollado un marco conceptual a modo de herramienta para los responsables de la formulación de políticas, los reguladores, los legisladores y otros para que puedan evaluar las oportunidades y los riesgos que presentan los diferentes tipos de sistemas de IA y para informar sus estrategias nacionales al respecto.

Puesto que todos los que estamos en este negocio tenemos cierta querencia por la tecnología en general y las infotecnologías en particular, me ha parecido pertinente motivar una lectura informada del trabajo de estos chavales. Siempre he encontrado útil disponer de herramientas conceptuales consistentes para poner en contexto los efectos de las, cada vez más abruptas y frecuentes, disrupciones tecnológicas que sufrimos y los picos de excitación que las acompañan.

Se trata de que las personas responsables de la definición de un marco regulatorio para la aplicación y el desarrollo de este tipo de soluciones tecnológicas se hagan las preguntas adecuadas; pero es evidente que si conseguimos un sentido más profundo de responsabilidad compartida que parta de ciertos principios y que implique, no solo a los profesionales capacitados para esos desarrollos, sino a la propia ciudadanía, ganaremos mucho. Lo digo en el mismo sentido en que Bunge hablaba de “la opinión pública y el desarrollo científico y técnico en una sociedad democrática”.

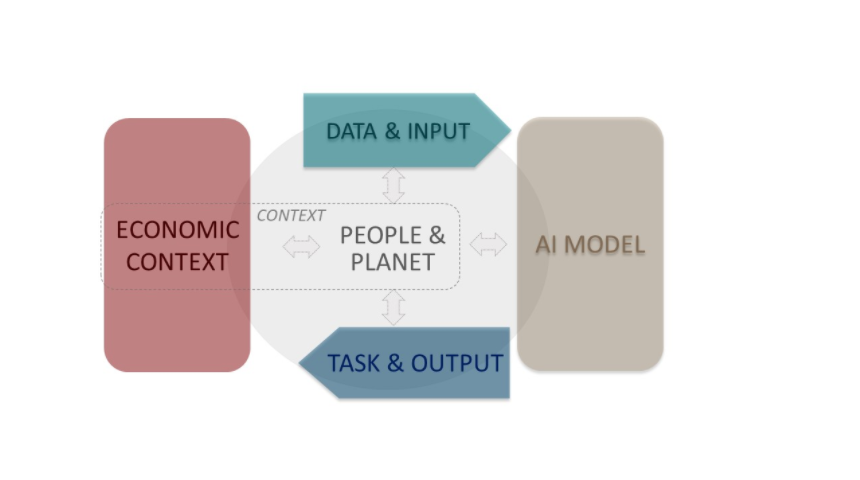

El marco de trabajo, que ilustra la figura, contempla cuatro dimensiones básicas de cualquier sistema basado en IA: el contexto socio-económico en el que se utiliza, la entrada, la salida y las tripas del sistema. Dentro de cada una de esas dimensiones, se incluyen una serie de criterios que ayudan a la clasificación de los diferentes sistemas.

Desde un punto de vista económico resultará relevante saber cuál es el sector de actividad en el que se aplicará la solución en cuestión (e.g. industria manufacturera, sanidad, etc.) o en qué área del negocio en concreto (e.g. atención al cliente, gestión de operaciones, etc.) bajo qué modelo de negocio y con qué madurez (e.g. piloto, prueba de concepto, producto pre-comercial, etc.).

En lo que se refiere a las personas y el medio natural, nos interesará fijarnos en aspectos como por ejemplo el nivel de competencia de los usuarios del sistema, o si su uso va a impactar en derechos fundamentales de las personas (e.g. libertad de expresión, privacidad, no discriminación, etc.) o si se verán afectados el medio ambiente o el bienestar de las personas (e.g. sanidad, educación, derechos sociales, etc.).

Los datos que servirán como entrada para nuestro sistema podrán ser inferidos, agregados, pueden ser datos sintéticos, dinámicos, más o menos estructurados, etc. Pueden ser datos provenientes de sensores, o recolectados por humanos… Nos interesará saber si los datos son públicamente accesibles o privados.

Las tripas de nuestro sistema se refieren en el marco conceptual como el “modelo de IA” que utiliza nuestro sistema. Deberíamos tener en consideración aspectos como el hecho de saber si se trata de un modelo simbólico o estadístico; o si utiliza aprendizaje supervisado o reforzado. Los aspectos de transparencia y “explicabilidad” van a resultar, asimismo, especialmente sensibles en el contexto actual.

En lo que se refiere a la salida de nuestro sistema, el marco de la OCDE propone la consideración de aspectos como qué tipo de tareas va a desempeñar el sistema (e.g. reconocimiento de imágenes, predicciones meteorológicas, recomendaciones de compra de contenidos, etc.) y con qué grado de autonomía… o cómo vamos a evaluar el rendimiento del mismo.

Como bien sabrá nuestra amable lectora, los modelos, en sentido estricto, no pueden aspirar a ser buenos o malos, correctos o incorrectos… Solo pueden aspirar a resultar “útiles”. En ese sentido podríamos considerar la consistencia de este marco de trabajo al hilo de alguno de los marcos universales de modelización que surgían dentro de la teoría general de sistemas.

e-Fumérides

En cualquier caso, ¿Qué peso crees que tiene la adopción de este tipo de herramientas conceptuales en el futuro desarrollo del ámbito que nos ocupa? ¿Crees que “lo que AI es lo que AI” o, por el contrario, podemos hacerlo mejor?